6.7 径向基函数和核¶

| 原文 | The Elements of Statistical Learning |

|---|---|

| 翻译 | szcf-weiya |

| 发布 | 2017-03-09 |

| 更新 | 2025-12-30 |

在第五章中,函数表示成基函数展开的形式:$f(x)=\sum_{j=1}^M\beta_jh_j(x)$.使用基函数展开进行灵活建模的技术有两部分构成,首先需要选取合适的基函数族,然后通过选择、正则化、或者两者都有的方法来控制表达式的复杂度.有些基函数族的元素是局部定义的,比如,B 样条在 $\IR$ 中局部定义.如果在特定区域中需要更多的灵活性,这个区域则需要用更多的基函数来表示(对于 B 样条,也就是需要更多结点).$\IR$ 局部基函数的张量积构成了 $\IR^p$ 中的局部基函数.不是所有的基函数都是局部的——举个例子,对于样条的截断幂基,或者在神经网络中使用的 S 型基函数 $\sigma(\alpha_0+\alpha x)$(见 第 11 章).虽然如此,复合函数 $f(x)$ 也可以显示出局部行为,因为参数的特定符号和值造成全局影响的抵消.举个例子,对于同样的函数空间截断幂基有等价的 B 样条基;这种情况下恰恰就是因为抵消.

核方法通过在目标点 $x_0$ 局部的区域中拟合简单的模型来实现灵活性.局部化通过加权核 $K_\lambda$ 来实现,并且单个观测权重为 $K_\lambda(x_0,x_i)$.

径向基函数 (Radial basis functions) 将核函数 $K_\lambda(\xi,x)$ 看成基函数.

weiya 注:Isotropic covariance vs. Radial basis functions

平稳的协方差函数是 $\x - \x’$ 的函数,而如果进一步只跟 $\x$ 和 $\x’$ 间的距离 $\vert \x-\x’\vert$ 有关,则称为 isotropic covariance,也称作 radial basis functions.

这得到模型 其中每个基元素由位置或者 原型 (prototype) 参数 $\xi_j$ 以及缩放参数 $\lambda_j$ 决定.$D$ 的一个流行的选择是标准高斯密度函数.有许多方式来学习参数 $\{\lambda_j,\xi_j,\beta_j\},j=1,\ldots,M$.为了简化,我们关注回归的最小二乘方法,并且采用高斯核.

- 优化关于所有参数的平方和

这个模型一般称为 RBF 网络,这是 S 型神经网络的替代选择,将在 第 11 章 讨论;$\xi_j$ 和 $\lambda_j$ 起到权重的作用.这个准则是有着多重局部最小点的非凸函数,并且优化的算法类似神经网络中的算法.

- 分开估计 $\{\lambda_j,\xi_j\}$ 和 $\beta_j$.给定前者,后者的估计是简单的最小二乘问题.通常单独用 $X$ 的分布,以非监督的方式选择核参数 $\lambda_j$ 和 $\xi_j$.其中一种方式是对训练 $x_i$ 拟合高斯混合密度模型,这样可以得到中心 $\xi_j$ 和缩放 $\lambda_j$.其它更特定的 (ad-hoc) 方式是使用聚类方法来确定原型 $\xi_j$,并且将 $\lambda_j=\lambda$ 看成是超参数.这些方式的显然缺点是条件分布 $\Pr(Y\mid X)$ 以及 $\E(Y\mid X)$ 在决定“主要作用集中在哪儿 (where the action is concentrated)” 时没有任何发言权.不过它们的优点是,可以更简单地实现.

weiya 注:

因为这些方式只用到 $X$ 的信息来决定 $\lambda_j$ 和 $\xi_j$,所以最后说它们的缺点是没有用到 $Y$ 的信息。

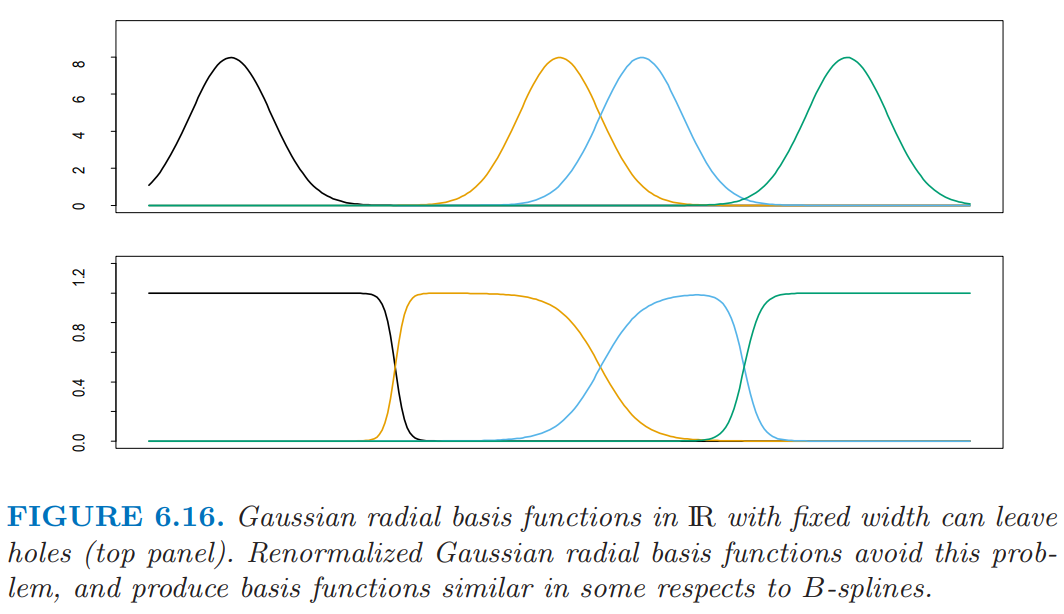

尽管看起来减少参数的个数,并假设 $\lambda_j=\lambda$ 为常数的方法很吸引人,但是这会带来糟糕的副作用——产生 洞 (holes),也就是 $\IR^p$ 存在某个区域,其中没有核有合适的支撑(如图 6.16(上)所示).对径向基函数重标准化,

可以避免这个问题(图 6.16(下)).

$\IR^p$ 中的 Nadaraya-Watson 核回归估计量 \eqref{6.2} 可以看成是重标准化后径向基函数的展开,

weiya 注: Recall

其中基函数 $h_i$ 确定了每个观测的位置以及系数;也就是说,$\xi_i=x_i,\hat\beta_i=y_i,i=1,\ldots,N$.

注意到展开式 \eqref{6.31} 与由 $K$ 导出的正则化问题的解 \eqref{5.50} 间的相似性.径向基函数搭建了现代“核方法”与局部拟合技巧间的桥梁.

weiya 注:Recall